|

Главная Случайная страница Контакты | Мы поможем в написании вашей работы! | |

Подходы к определению количества информации. Формулы Хартли и Шеннона

|

|

Американский инженер Р. Хартли в 1928 г. процесс получения информации рассматривал как выбор одного сообщения из конечного наперёд заданного множества из N равновероятных сообщений, а количество информации I, содержащееся в выбранном сообщении, определял как двоичный логарифм N.

Формула Хартли:

I = log2 N.

Допустим, нужно угадать одно число из набора чисел от единицы до ста. По формуле Хартли можно вычислить, какое количество информации для этого требуется: I = log2100 > 6,644. Таким образом, сообщение о верно угаданном числе содержит количество информации, приблизительно равное 6,644 единицы информации.

Приведем другие примеры равновероятных сообщений:

1. при бросании монеты: "выпала решка", "выпал орел";

2. на странице книги: "количество букв чётное", "количество букв нечётное".

Определим теперь, являются ли равновероятными сообщения "первой выйдет из дверей здания женщина" и "первым выйдет из дверей здания мужчина". Однозначно ответить на этот вопрос нельзя. Все зависит от того, о каком именно здании идет речь. Если это, например, станция метро, то вероятность выйти из дверей первым одинакова для мужчины и женщины, а если это военная казарма, то для мужчины эта вероятность значительно выше, чем для женщины.

Для задач такого рода американский учёный Клод Шеннон предложил в 1948 г. другую формулу определения количества информации, учитывающую возможную неодинаковую вероятность сообщений в наборе.

Формула Шеннона:

I = - (p 1log2 p 1 + p 2 log2 p 2 +... + p N log2 pN),

где pi — вероятность того, что именно i -е сообщение выделено в наборе из N сообщений.

Легко заметить, что если вероятности p 1,..., pN равны, то каждая из них равна 1 /N, и формула Шеннона превращается в формулу Хартли.

Клод Шеннон определил информацию, как снятую неопределенность. Точнее сказать, получение информации - необходимое условие для снятия неопределенности. Неопределенность возникает в ситуации выбора. Задача, которая решается в ходе снятия неопределенности – уменьшение количества рассматриваемых вариантов (уменьшение разнообразия), и в итоге выбор одного соответствующего ситуации варианта из числа возможных. Снятие неопределенности дает возможность принимать обоснованные решения и действовать. В этом управляющая роль информации.

Представьте, что вы зашли в магазин и попросили продать вам жевательную резинку. Продавщица, у которой, скажем, 16 сортов жевательной резинки, находится в состоянии неопределенности. Она не может выполнить вашу просьбу без получения дополнительной информации. Если вы уточнили, скажем, - «Orbit», и из 16 первоначальных вариантов продавщица рассматривает теперь только 8, вы уменьшили ее неопределенность в два раза (забегая вперед, скажем, что уменьшение неопределенности вдвое соответствует получению 1 бита информации ). Если вы, не мудрствуя лукаво, просто указали пальцем на витрине, - «вот эту!», то неопределенность была снята полностью. Опять же, забегая вперед, скажем, что этим жестом в данном примере вы сообщили продавщице 4 бита информации.

Ситуация максимальной неопределенности предполагает наличие нескольких равновероятных альтернатив (вариантов), т.е. ни один из вариантов не является более предпочтительным. Причем, чем больше равновероятных вариантов наблюдается, тем больше неопределенность, тем сложнее сделать однозначный выбор и тем больше информации требуется для этого получить. Для N вариантов эта ситуация описывается следующим распределением вероятностей: {1 /N,1 /N, …,1 /N }.

Минимальная неопределенность равна 0, т.е. эта ситуация полной определенности, означающая что выбор сделан, и вся необходимая информация получена. Распределение вероятностей для ситуации полной определенности выглядит так: {1, 0, …0}.

Величина, характеризующая количество неопределенности в теории информации обозначается символом H и имеет название энтропия, точнее информационная энтропия.

Энтропия (H) – мера неопределенности, выраженная в битах. Так же энтропию можно рассматривать как меру равномерности распределения случайной величины.

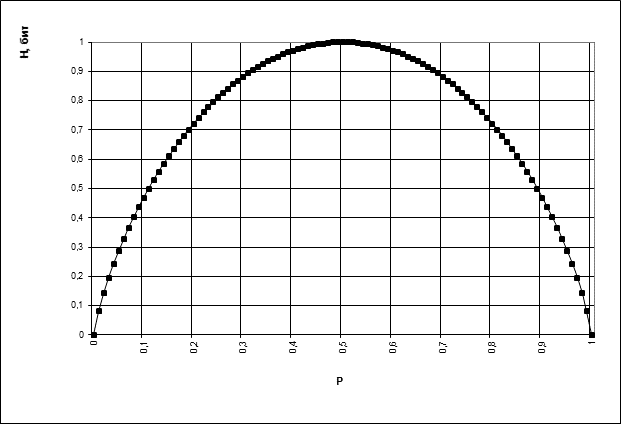

Рис. 3.4 Поведение энтропии для случая двух альтернатив

На рис. 3.4 показано поведение энтропии для случая двух альтернатив, при изменении соотношения их вероятностей (P, (1- P)).

Максимального значения энтропия достигает в данном случае тогда, когда обе вероятности равны между собой и равны 1/2, нулевое значение энтропии соответствует случаям (P 0=0, P 1=1) и (P 0=1, P 1=0).

Количество информации I и энтропия H характеризуют одну и ту же ситуацию, но с качественно противоположенных сторон. I – это количество информации, которое требуется для снятия неопределенности H. По определению Леона Бриллюэна информация есть отрицательная энтропия (негэнтропия).

Когда неопределенность снята полностью, количество полученной информации I равно изначально существовавшей неопределенности H.

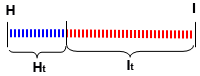

При частичном снятии неопределенности, полученное количество информации и оставшаяся неснятой неопределенность составляют в сумме исходную неопределенность. Ht + It = H (рис. 3.5).

|

Рис. 3.5 Связь между энтропией и количеством информации

По этой причине, формулы, которые будут представлены ниже для расчета энтропии H являются и формулами для расчета количества информации I, т.е. когда речь идет о полном снятии неопределенности, H в них может заменяться на I.

В общем случае, энтропия H и количество получаемой в результате снятия неопределенности информации I зависят от исходного количества рассматриваемых вариантов N и априорных вероятностей реализации каждого из них P: { p 0, p 1, …, pN- 1}, т.е. H=F (N, P). Расчет энтропии в этом случае производится по формуле Шеннона, предложенной им в 1948 году в статье "Математическая теория связи".

В частном случае, когда все варианты равновероятны, остается зависимость только от количества рассматриваемых вариантов, т.е. H=F (N). В этом случае формула Шеннона значительно упрощается и совпадает с формулой Хартли, которая впервые была предложена американским инженером Ральфом Хартли в 1928 году, т.е. на 20 лет раньше.

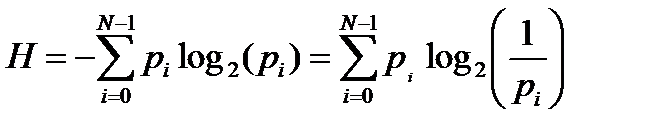

Формула Шеннона имеет следующий вид:

(3.1)

(3.1)

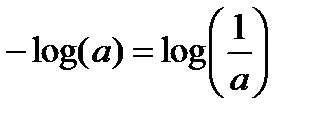

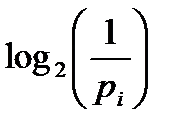

Знак минус в формуле (2.1) не означает, что энтропия – отрицательная величина. Объясняется это тем, что pi £ 1 по определению, а логарифм числа меньшего единицы - величина отрицательная. По свойству логарифма  , поэтому эту формулу можно записать и во втором варианте, без минуса перед знаком суммы.

, поэтому эту формулу можно записать и во втором варианте, без минуса перед знаком суммы.

Выражение  интерпретируется как частное количество информации It, получаемое в случае реализации i -ого варианта. Энтропия в формуле Шеннона является средней характеристикой – математическим ожиданием распределения случайной величины { I 0, I 1, …, I N- 1}.

интерпретируется как частное количество информации It, получаемое в случае реализации i -ого варианта. Энтропия в формуле Шеннона является средней характеристикой – математическим ожиданием распределения случайной величины { I 0, I 1, …, I N- 1}.

Приведем пример расчета энтропии по формуле Шеннона. Пусть в некотором учреждении состав работников распределяется так: 3/4 - женщины, 1/4 - мужчины. Тогда неопределенность, например, относительно того, кого вы встретите первым, зайдя в учреждение, будет рассчитана рядом действий, показанных в табл. 3.1.

Таблица 3.1

| pi | 1/ pi | Ii= log2(1/ pi), бит | pi* log2(1/ pi), бит | |

| Ж | 3/4 | 4/3 | log2(4/3)=0,42 | 3/4 * 0,42=0,31 |

| М | 1/4 | 4/1 | log2(4)=2 | 1/4 * 2=0,5 |

| å | H= 0,81 бит |

Мы уже упоминали, что формула Хартли – частный случай формулы Шеннона для равновероятных альтернатив.

Подставив в формулу (2.1) вместо pi его (в равновероятном случае не зависящее от i)значение  , получим:

, получим:

.

.

Таким образом, формула Хартли выглядит очень просто:

(3.2)

(3.2)

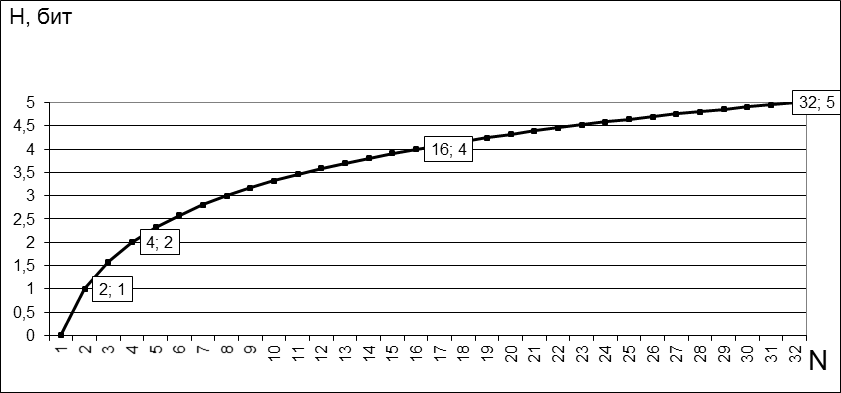

Из нее явно следует, что чем больше количество альтернатив (N), тем больше неопределенность (H). Логарифмирование по основанию 2 приводит количество вариантов к единицам измерения информации – битам. На рис.3.6 представлена зависимость энтропии от количества равновероятных вариантов выбора.

Рис. 3.6 Зависимость энтропии от количества равновероятных вариантов выбора (равнозначных альтернатив)

Для решения обратных задач, когда известна неопределенность (H) или полученное в результате ее снятия количество информации (I) и нужно определить какое количество равновероятных альтернатив соответствует возникновению этой неопределенности, используют обратную формулу Хартли, которая выглядит еще проще:

. (3.3)

. (3.3)

Например, если известно, что в результате определения того, что интересующий нас Коля Иванов живет на втором этаже, было получено 3 бита информации, то количество этажей в доме можно определить по формуле (2.3), как N= 23 = 8этажей.

Если же вопрос стоит так: «В доме 8 этажей, какое количество информации мы получили, узнав, что интересующий нас Коля Иванов живет на втором этаже?», нужно воспользоваться формулой (2.2): I = log2(8) = 3 бита.

До сих пор мы приводили формулы для расчета энтропии (неопределенности) H, указывая, что H в них можно заменять на I, потому что количество информации, получаемое при полном снятии неопределенности некоторой ситуации, количественно равно начальной энтропии этой ситуации.

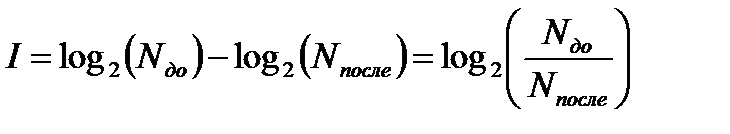

Но неопределенность может быть снята только частично, поэтому количество информации I, получаемой из некоторого сообщения, вычисляется как уменьшение энтропии, произошедшее в результате получения данного сообщения.

(3.4)

(3.4)

Для равновероятного случая, используя для расчета энтропии формулу Хартли, получим:

(3.5)

(3.5)

Второе равенство выводится на основании свойств логарифма. Таким образом, в равновероятном случае I зависит от того, во сколько раз изменилось количество рассматриваемых вариантов выбора (рассматриваемое разнообразие).

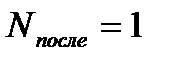

Исходя из (3.5) можно вывести следующее:

Если  , то

, то  - полное снятие неопределенности, количество полученной в сообщении информации равно неопределенности, которая существовала до получения сообщения.

- полное снятие неопределенности, количество полученной в сообщении информации равно неопределенности, которая существовала до получения сообщения.

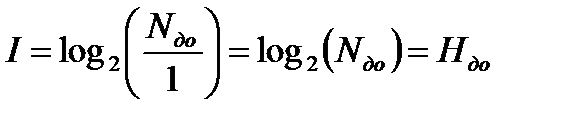

Если  , то

, то  - неопределенности не изменилась, следовательно, информации получено не было.

- неопределенности не изменилась, следовательно, информации получено не было.

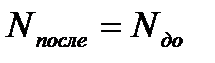

Если  , то

, то  =>

=>  ,

,

если  , то

, то  =>

=>  .

.

Т.е. количество полученной информации будет положительной величиной, если в результате получения сообщения количество рассматриваемых альтернатив уменьшилось, и отрицательной, если увеличилось.

Если количество рассматриваемых альтернатив в результате получения сообщения уменьшилось вдвое, т.е.  , то I =log2(2)=1 бит. Другими словами, получение 1 бита информации исключает из рассмотрения половину равнозначных вариантов.

, то I =log2(2)=1 бит. Другими словами, получение 1 бита информации исключает из рассмотрения половину равнозначных вариантов.

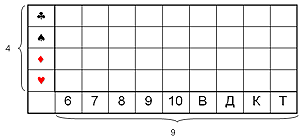

Рассмотрим в качестве примера опыт с колодой из 36 карт (рис.3.7).

Рис. 3.7 Иллюстрация к опыту с колодой из 36-ти карт

Пусть некто вынимает одну карту из колоды. Нас интересует, какую именно из 36 карт он вынул. Изначальная неопределенность, рассчитываемая по формуле (3.2), составляет H= log2(36)@5,17 бит. Вытянувший карту сообщает нам часть информации. Используя формулу (3.5), определим, какое количество информации мы получаем из этих сообщений:

Вариант A. “Это карта красной масти”.

I =log2(36/18)=log2(2)=1бит (красных карт в колоде половина, неопределенность уменьшилась в 2 раза).

Вариант B. “Это карта пиковой масти”.

I =log2(36/9)=log2(4)=2 бита (пиковые карты составляют четверть колоды, неопределенность уменьшилась в 4 раза).

Вариант С. “Это одна из старших карт: валет, дама, король или туз”.

I =log2(36)–log2(16)=5,17-4=1,17 бита (неопределенность уменьшилась больше чем в два раза, поэтому полученное количество информации больше одного бита).

Вариант D. “Это одна карта из колоды".

I =log2(36/36)=log2(1)=0 бит (неопределенность не уменьшилась - сообщение не информативно).

Вариант E. “Это дама пик".

I =log2(36/1)=log2(36)=5,17 бит (неопределенность полностью снята).

Задача 1. Какое количество информации будет содержать зрительное сообщение о цвете вынутого шарика, если в непрозрачном мешочке находится 50 белых, 25 красных, 25 синих шариков?

Решение.

1) всего шаров 50+25+25=100

2) вероятности шаров 50/100=1/2, 25/100=1/4, 25/100=1/4

3) I = -(1/2 log21/2 + 1/4 log21/4 + 1/4 log21/4) = -(1/2(0-1) +1/4(0-2) +1/4(0-2)) = =1,5 бит

Задача 2. В корзине лежит 16 шаров разного цвета. Сколько информации несет сообщение, что достали белый шар?

Решение. Т.к. N = 16 шаров, то I = log2 N = log2 16 = 4 бит.

Задача 3. В корзине лежат черные и белые шары. Среди них18 черных шаров. Сообщение о том, что достали белый шар, несет 2 бита информации. Сколько всего шаров в корзине?

1) 18 2) 24 3) 36 4)48

Решение. Найдем по формуле Шеннона вероятность получения белого шара: log2N=2, N=4, следовательно, вероятность получения белого шара равна 1/4 (25%), а вероятность получения черного шара соответственно 3/4(75%). Если 75% всех шариков черные, их количество 18, тогда 25% всех шариков белые, их количество (18*25)/75=6.

Осталось найти количество всех шариков в корзине 18+6=24.

Ответ: 24 шарика.

Задача 4. В некоторой стране автомобильный номер длиной 5 символов составляется из заглавных букв (всего используется 30 букв) и десятичных цифр в любом порядке. Каждый символ кодируется одинаковым и минимально возможным количеством бит, а каждый номер – одинаковым и минимально возможным количеством байт. Определите объем памяти, необходимый для хранения 50 автомобильных номеров.

1) 100 байт 2) 150 байт 3) 200 байт 4)250 байт

Решение. Количество символов используемых для кодирования номера составляет: 30 букв + 10 цифр = 40 символов. Количество информации несущий один символ равен 6 бит (2I=40, но количество информации не может быть дробным числом, поэтому берем ближайшую степень двойки большую количества символов 26=64).

Мы нашли количество информации, заложенное в каждом символе, количество символов в номере равно 5, следовательно, 5*6=30 бит. Каждый номер равен 30 битам информации, но по условию задачи каждый номер кодируется одинаковым и минимально возможным количеством байт, следовательно, нам необходимо узнать, сколько байт в 30 битах. Если разделить 30 на 8 получится дробное число, а нам необходимо найти целое количество байт на каждый номер, поэтому находим ближайший множитель 8-ки, который превысит количество бит, это 4 (8*4=32). Каждый номер кодируется 4 байтами.

Для хранения 50 автомобильных номеров потребуется: 4*50=200 байт.

Выбор оптимальной стратегии в игре "Угадай число". На получении максимального количества информации строится выбор оптимальной стратегии в игре "Угадай число", в которой первый участник загадывает целое число (например, 3) из заданного интервала (например, от 1 до 16), а второй - должен "угадать" задуманное число. Если рассмотреть эту игру с информационной точки зрения, то начальная неопределенность знаний для второго участника составляет 16 возможных событий (вариантов загаданных чисел).

При оптимальной стратегии интервал чисел всегда должен делиться пополам, тогда количество возможных событий (чисел) в каждом из полученных интервалов будет одинаково и отгадывание интервалов равновероятно. В этом случае на каждом шаге ответ первого игрока ("Да" или "Нет") будет нести максимальное количество информации (1 бит).

Как видно из табл. 1.1, угадывание числа 3 произошло за четыре шага, на каждом из которых неопределенность знаний второго участника уменьшалась в два раза за счет получения сообщения от первого участника, содержащего 1 бит информации. Таким образом, количество информации, необходимое для отгадывания одного из 16 чисел, составило 4 бита.

| Таблица 2.1. Информационная модель игры "Угадай число" | ||||||||||||||||||||

|

Контрольные вопросы и задания

1. Априори известно, что шарик находится в одной из трех урн: А, В или С. Определите, сколько бит информации содержит сообщение о том, что он находится в урне В.

Варианты: 1 бит, 1,58 бита, 2 бита, 2,25 бита.

2. Вероятность первого события составляет 0,5, а второго и третьего 0,25. Чему для такого распределения равна информационная энтропия. Варианты: 0,5 бита, 1 бит, 1,5 бита, 2 бита, 2,5 бита, 3 бита.

3. Вот список сотрудников некоторой организации:

| Год рождения | Фамилия | Имя |

| Иванова | Марина | |

| Иванова | Наталья | |

| Петрова | Татьяна | |

| Звягина | Ирина |

Определите количество информации, недостающее для того, чтобы выполнить следующие просьбы:

Пожалуйста, позовите к телефону Иванову.

Меня интересует одна ваша сотрудница, она 1970 года рождения.

4. Какое из сообщений несет больше информации:

· В результате подбрасывания монеты (орел, решка) выпала решка.

· На светофоре (красный, желтый, зеленый) сейчас горит зеленый свет.

· В результате подбрасывания игральной кости (1, 2, 3, 4, 5, 6) выпало 3 очка.

Дата публикования: 2014-11-19; Прочитано: 4293 | Нарушение авторского права страницы | Мы поможем в написании вашей работы!