|

Главная Случайная страница Контакты | Мы поможем в написании вашей работы! | |

Определение количества информации и энтропии

|

|

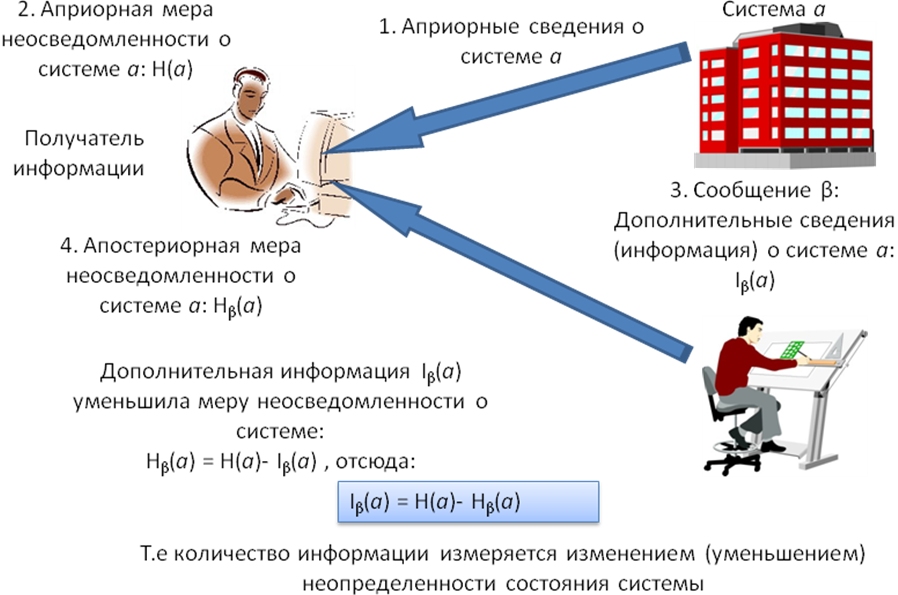

Количество информации I определяет изменение (уменьшение) неопределенности состояния системы.

Энтропия – это мера «хаотичности», неопределенности информации или состояния некоторой системы.

Пример. Получение информации о какой-либо системе всегда связано с изменением степени неосведомленности получателя о состоянии этой системы.

Энтропия, как мера недостающей информации

Iβ(а) = Н(а)- Нβ(а)

Если конечная неопределенность Нβ(а) обратится в нуль, т.е. система а изучена полностью, то первоначальное неполное знание заменится полным знанием и количество информации Iβ(а) = Н(а). Иными словами, энтропия системы Н(а) может рассматриваться как мера недостающей информации.

Дата публикования: 2014-10-20; Прочитано: 1810 | Нарушение авторского права страницы | Мы поможем в написании вашей работы!