|

Главная Случайная страница Контакты | Мы поможем в написании вашей работы! | |

Эффект переобучения сети или эффект бабушкиного воспитания

|

|

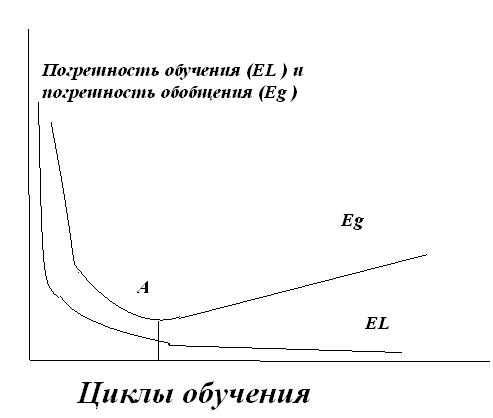

Погрешность обучения при увеличении количества итераций монотонно уменьшается, тогда как погрешность обобщения снижается только до определенного предела, а затем снова начинает расти. Таким образом слишком долгое обучение может привести к переобучению сети.

Рисунок 2

Эффект переобучения объясняется в слишком детальной адаптации весов к несущественным флуктуациям обучающих примеров. Такая ситуация наблюдается при использовании сети с чрезмерным (по сравнению с необходимым) количеством весов. Это особенно заметно, если НС содержит «лишние» веса, которые адаптируются к любым нерегулярностям обучающих примеров, воспринимая их в качестве важных характеристик. В результате они становятся источником значительных погрешностей воспроизведения. Для предупреждения этого эффекта в обучающем множестве выделяется подмножество V, которое в процессе обучения применяется для проверки уровня обобщения (в точке А на рис.2 обучение прекращается).

Погрешность обобщения можно вычислить по формуле среднеквадратичной ошибки

ЕG(W)=1/2 ∑(Yk - Dk)2,

Где М-размер тестового подмножества;

Yk -прогноз НС на выходе выходного слоя, полученный после предъявления сети входного вектора ХК;

Dk – вектор ожидаемого выходного сигнала.

Дата публикования: 2014-10-18; Прочитано: 920 | Нарушение авторского права страницы | Мы поможем в написании вашей работы!