|

Главная Случайная страница Контакты | Мы поможем в написании вашей работы! | |

II-2.5.5. Уравнение Беллмана

|

|

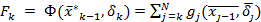

На основании принципа оптимальности Беллмана можно получить основное уравнение динамического программирования, или уравнение Беллмана.

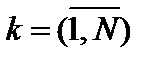

Рассмотрим  -шаговый управляемый марковский процесс (II.8) с целевой функцией (II.10) и задачу его оптимизации (II.9).

-шаговый управляемый марковский процесс (II.8) с целевой функцией (II.10) и задачу его оптимизации (II.9).

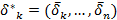

Пусть стратегия (II.13) и траектория (II.14) являются соответственно оптимальной стратегией и траекторией поставленной задачи.

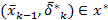

Выберем произвольное состояние системы в момент времени  ,

,  и рассмотрим

и рассмотрим  – шаговый процесс, начинающийся из состояния

– шаговый процесс, начинающийся из состояния  :

:

. (II.20)

. (II.20)

Задача оптимизации на процессе (II.20) ставится так же, как и задача (II.9) для всего процесса (II.8). Эффективность управления процессом (II.20) оценим целевой функцией

, (II.21)

, (II.21)

где  - управление (стратегия) процессом.

- управление (стратегия) процессом.

Пусть  - оптимальное управление процессом (II.20), а

- оптимальное управление процессом (II.20), а

оптимальная траектория, отвечающая этому управлению. Эффективность управления  оценивается величиной

оценивается величиной

(II.22)

(II.22)

На основании принципа оптимальности Беллмана оптимальная стратегия  обладает тем свойством, что для любого состояния

обладает тем свойством, что для любого состояния  и управляющего решения

и управляющего решения  последующие управляющие решения

последующие управляющие решения  должны составлять оптимальную стратегию относительно состояния

должны составлять оптимальную стратегию относительно состояния  , т.е. можно записать, что

, т.е. можно записать, что

(II.23)

Равенство (II.23) имеет место, если  , а

, а  Если в состоянии

Если в состоянии  принимается произвольное допустимое управляющее решение

принимается произвольное допустимое управляющее решение  , то стратегия

, то стратегия  будет являться допустимой для процесса (1.20) и её эффективность будет оцениваться величиной

будет являться допустимой для процесса (1.20) и её эффективность будет оцениваться величиной

(II.24)

(II.24)

Так как стратегия  является оптимальной, можно записать

является оптимальной, можно записать

(II.25)

(II.25)

причём неравенство (II.25) справедливо для любых  , следовательно,

, следовательно,

(II.26)

(II.26)

В силу произвольности выбора момента времени  и состояния

и состояния  полученное соотношение справедливо для любых

полученное соотношение справедливо для любых  . Полученное соотношение (II.26) называется уравнением Беллмана.

. Полученное соотношение (II.26) называется уравнением Беллмана.

Дата публикования: 2015-09-17; Прочитано: 308 | Нарушение авторского права страницы | Мы поможем в написании вашей работы!