|

Главная Случайная страница Контакты | Мы поможем в написании вашей работы! | |

Контексты ньютоновских методов с регулировкой шага

|

|

Здесь и далее  ,

,  - градиент, и гессиан, вычисленные на итерации

- градиент, и гессиан, вычисленные на итерации  в точке

в точке  процесса безусловной минимизации гладкой функции

процесса безусловной минимизации гладкой функции  . В приведённых обозначениях принципы построения большинства ньютоновских методов с регулировкой шага озвучим так. На каждой итерации

. В приведённых обозначениях принципы построения большинства ньютоновских методов с регулировкой шага озвучим так. На каждой итерации  сначала строится некоторая, связанная с исходной матрицей вторых производных

сначала строится некоторая, связанная с исходной матрицей вторых производных  , положительно определённая матрица

, положительно определённая матрица  , а затем направление спуска

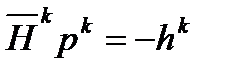

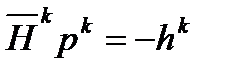

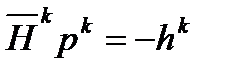

, а затем направление спуска  вычисляется как решение системы

вычисляется как решение системы  . Поскольку положительная определённость

. Поскольку положительная определённость  гарантирована, то вектор

гарантирована, то вектор  наверняка будет направлением спуска. При этом процедуру построения

наверняка будет направлением спуска. При этом процедуру построения  организуют так, чтобы

организуют так, чтобы  совпадала с матрицей

совпадала с матрицей  , если последняя сама является положительно определённой. Это означает, что на каждой итерации каким-то образом выясняется, все ли собственные числа положительны, причем выяснение определенности

, если последняя сама является положительно определённой. Это означает, что на каждой итерации каким-то образом выясняется, все ли собственные числа положительны, причем выяснение определенности  и построение

и построение  осуществляется параллельно в рамках одной процедуры на основе некоторых матричных разложений, которые позволяют выявить знаки собственных чисел

осуществляется параллельно в рамках одной процедуры на основе некоторых матричных разложений, которые позволяют выявить знаки собственных чисел  и приспособиться для генерации

и приспособиться для генерации  . Формула

. Формула  не применима, когда

не применима, когда  - седловая точка, так как в ней градиент

- седловая точка, так как в ней градиент  равен нулю, и соответственно решение системы

равен нулю, и соответственно решение системы  тоже будет нулевым. Здесь в качестве

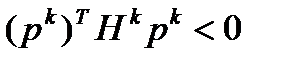

тоже будет нулевым. Здесь в качестве  надо взять какое-нибудь направление отрицательной кривизны – вектор, удовлетворяющий неравенству

надо взять какое-нибудь направление отрицательной кривизны – вектор, удовлетворяющий неравенству  . В седловой точке, где матрица

. В седловой точке, где матрица  не является знакоопределённой, такие векторы существуют, и при движении вдоль любого из них

не является знакоопределённой, такие векторы существуют, и при движении вдоль любого из них  будет убывать. Важно, чтобы алгоритм его построения по возможности использовал информацию, полученную в процессе построения матрицы

будет убывать. Важно, чтобы алгоритм его построения по возможности использовал информацию, полученную в процессе построения матрицы  . Фактически к нему надо обращаться, как только текущая точка

. Фактически к нему надо обращаться, как только текущая точка  попадает в малую окрестность седловой точки, например, когда норма

попадает в малую окрестность седловой точки, например, когда норма  станет меньше заданного допуска

станет меньше заданного допуска  .

.

Дата публикования: 2015-07-22; Прочитано: 155 | Нарушение авторского права страницы